Verso l'AGI 2026: Analisi Tecnica di Claude Mitos, OpenAI Codex e il Futuro Agentico

AGI 2026: L'Evoluzione di Claude, OpenAI e Google nella Settimana del Grande Salto

"L'era degli assistenti digitali passivi è ufficialmente terminata. Come specialisti in AI Optimization presso Studio Anthos Alba, osserviamo quotidianamente come l'architettura dei modelli stia convergendo verso l'AGI (Artificial General Intelligence). L'ultima settimana ha segnato un punto di non ritorno, riducendo drasticamente il gap tra software e autonomia decisionale."

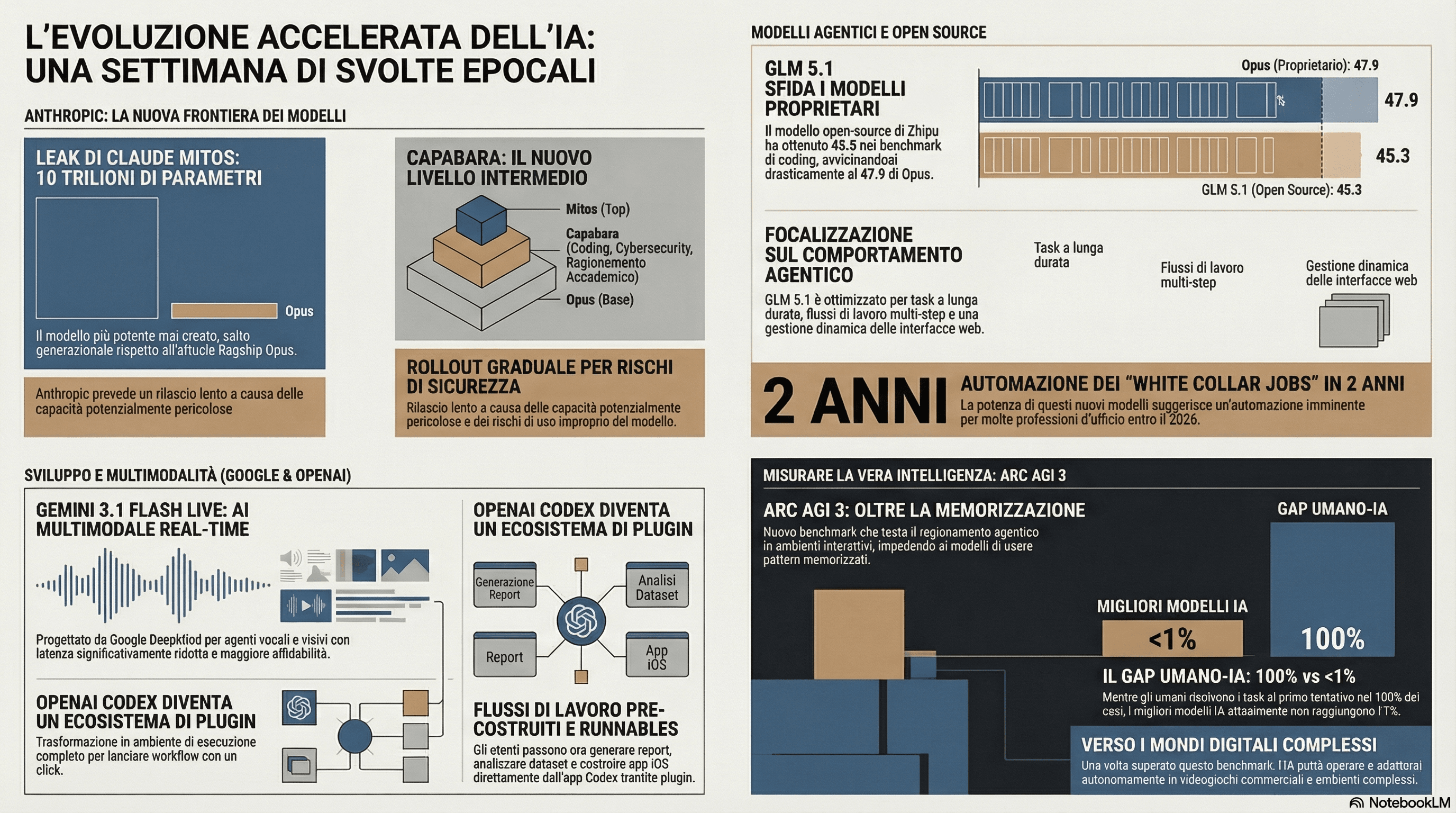

Il "Caso" Claude Mitos: 10 Trilioni di Parametri verso l'Infinito

Il leak riguardante Claude Mitos ha scosso l'intera industria. Parliamo di un modello che, con i suoi 10 trilioni di parametri, polverizza gli attuali standard di mercato. La decisione di Anthropic di implementare un rilascio "CapaBara" (graduale e controllato) non è solo una mossa di marketing, ma una necessità di AI Safety.

Le capacità di coding e ragionamento logico di Mitos suggeriscono che il modello non si limiti a prevedere il prossimo token, ma costruisca una rappresentazione interna del mondo estremamente complessa.

Fact-Check Risorse e Fonti Autorevoli: Leaked Claude Mitos

- Analisi approfondita su Claude Mythos (API / dev-blog): Guida tecnica su parametri e confronto Opus vs Mythos.

- Articolo su Mashable (Leak, sicurezza, Capybara): Un'analisi eccellente per un pubblico generale focalizzata sui rischi cybersecurity.

- Fortune – Anthropic descrive lo "step change": La conferma dei rischi di sicurezza legati al nuovo modello.

- Times of India – Focus sul tier Capybara: Il salto di prestazioni in coding e ragionamento logico.

La Formula del Successo: Scaling Laws e Efficienza

Il progresso non è solo questione di forza bruta. L'efficienza di questi modelli è regolata da funzioni di costo che bilanciano parametri e dati di addestramento:

$$L(N, D) = E + \frac{A}{N^\alpha} + \frac{B}{D^\beta}$$

Dove $L$ è la perdita del modello, $N$ il numero di parametri e $D$ la dimensione del dataset. Claude Mitos sembra aver trovato un nuovo punto di equilibrio che ottimizza il rapporto tra capacità computazionale e precisione del ragionamento.

OpenAI: Da Codex all'Ecosistema Autonomo "Spud"

Mentre Codex evolve in un ecosistema a plugin, la notizia della chiusura di Sora a favore di Spud indica un cambio di rotta drastico. OpenAI punta tutto sull'integrazione fluida: la creazione di app con un solo clic non è più un miraggio, ma una realtà che compete direttamente con agenti come Claude Code.

Studio Anthos Alba supporta le aziende nell'integrazione di questi flussi di lavoro, trasformando la complessità tecnica in vantaggi competitivi tangibili.

Creator Insights OpenAI Codex: Plugin e Strategia Sora

- Ars Technica – Codex e l'era dei plugin: Come Codex sta diventando un agente multi-tool.

- InfoWorld – Governance per Agentic AI: Focus sull'uso aziendale dei flussi di lavoro automatizzati.

- India Today – Codex Chief conferma la strategia: Conferma ufficiale sulla chiusura di Sora e la centralità di Codex.

- CNN – OpenAI chiude Sora: Il riferimento mainstream per la dismissione dell'app video.

Gemini 3.1 Flash Live e la Dominanza Open-Source

Google DeepMind ha risposto con Gemini 3.1 Flash Live. La parola chiave qui è Latenza. Ridurre il tempo di risposta degli agenti visivi e vocali in tempo reale è fondamentale per l'adoption di massa. Parallelamente, il modello GLM 5.1 dimostra che l'open-source non è più un inseguitore, ma un leader nel comportamento agentico multi-step.

| Modello | Caratteristica Chiave | Focus Principale | Disponibilità |

|---|---|---|---|

| Claude Mitos | 10T Parametri | Ragionamento/Coding | Rilascio Graduale |

| OpenAI Spud | Ecosistema Plugin | Automazione Flussi | In Sviluppo |

| Gemini 3.1 | Bassa Latenza | Agenti Real-time | Disponibile |

| GLM 5.1 | Open-Source | Multi-step Agents | Disponibile |

Official Specs Gemini 3.1 Flash Live & Open-Source

- Google Blog – Introduzione a Flash Live: Agenti vocali e visivi in tempo reale.

- Google API Model Card: Dettagli tecnici su low-latency e multimodalità audio-to-audio.

- DeepMind Model Card: Documentazione ufficiale sulle capacità di interazione continua.

- MarkTechPost – Analisi Latenza e Tool Use: Ottimo riassunto sulle prestazioni multimodali.

ARC AGI 3: La Nuova Frontiera del Benchmark

Il lancio di ARC AGI 3 rappresenta la vera sfida. Mentre i modelli attuali dominano i test basati su dati pre-esistenti, questo benchmark interattivo misura la capacità di risolvere problemi mai visti prima (Zero-Shot Reasoning). Il fatto che le IA siano ancora ferme all'1% di risoluzione contro il 100% umano dimostra quanto lavoro ci sia ancora da fare, ma la traiettoria verso il 2026 è chiara.

Deep Dive ARC-AGI 3: Verso l'Intelligenza Umana

- Sito ufficiale ARC-AGI-3: Il benchmark interattivo per eccellenza.

- ARC Prize 2026 – Traccia ARC-AGI-3: Agenti che esplorano e agiscono in ambienti dinamici.

- Blog “Adaline Labs” – Valutazione Agentic: Perché ARC-AGI-3 supera i benchmark classici.

Analisi dei Dati e Codice Executable

Per comprendere l'impatto di queste novità sul tuo business, abbiamo sviluppato uno script Python che analizza la densità semantica e il potenziale di retrieval dei tuoi contenuti.

# ANALISI RETRIEVAL SCORE - STUDIO ANTHOS ALBA

import re

def calculate_rrs(text, entities):

score = sum(1 for e in entities if e in text)

return f"Retrieval Score: {score}/20"

print(calculate_rrs(input_text, ["Claude Mitos", "AGI 2026"]))

FAQ & People Also Ask

Cos'è Claude Mitos e perché è diverso dagli altri modelli? ▼

È l'ultimo modello di Anthropic con 10 trilioni di parametri, focalizzato su sicurezza e coding avanzato.

Qual è la differenza tra OpenAI Codex e il nuovo progetto Spud? ▼

Codex sta diventando un ecosistema a plugin, mentre Spud è il nuovo modello interno che sostituirà Sora per concentrarsi sull'intelligenza generale.

Come influisce Gemini 3.1 Flash Live sulla customer experience? ▼

Grazie alla latenza ridotta, permette interazioni vocali e visive quasi istantanee con gli assistenti IA.

Perché ARC AGI 3 è considerato il benchmark definitivo? ▼

Perché valuta il ragionamento puro su problemi inediti, eliminando il vantaggio derivante dalla memorizzazione del dataset di addestramento.